OpenAI语音模型“炸场” 15秒样本即可复刻人声

继文生视频大模型Sora后,近日,OpenAI终于将按捺许久的语音引擎模型—Voice Engine公之于众。

利用文本输入和单个15秒音频样本,Voice Engine就能生成与原说话者非常相似且情感丰富的自然语音。不过,和文本生成视频模型Sora一样,目前OpenAI只针对少部分内测用户开放Voice Engine。

OpenAI在其官网披露,2022年底,Voice Engine就被首次开发,并已经用它来支持文本转语音API以及ChatGPT语音和朗读中可用的预设语音。但考虑到合成语音被滥用的潜在风险,OpenAI选择了谨慎有序地推进和发布Voice Engine。

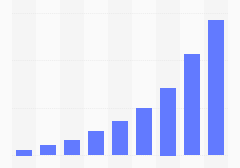

近两年,全球生成式AI应用规模呈现爆发式增长。据IDC预测,全球AI软件市场规模有望从2022年的640亿美元增长至2027年的2790亿美元,复合增长率为31.4%。

华泰证券分析师认为,随着基础模型能力优化,多模态应用有望在内容创作、AI教育、虚拟陪伴等场景加速落地。

Voice Engine的问世,解锁了语音模型的更多可能性,例如辅助阅读、视频转译等,也将在发音障碍人群的语言表达上提供有效帮助。

当AI瞄准声音克隆技术

去年,霉霉说地道中文的视频火上微博热搜,而这背后的AI工具来自Voice Engine的采用者之一—AIGC初创公司HeyGen,此话题的阅读量超600万。

通过Voice Engine进行实时转换翻译,说话者将保留原始口音,原语言不仅能转换成中文、英文、日文等各类语言,也能让面部嘴型完美匹配。

除此之外,特朗普随口飙一段中文、郭德纲用英语说相声、蔡明阿姨讲段子的视频也在各大社交平台上广为流传。

Voice Engine的官宣也有迹可循。2024年3月19日,OpenAI已经为“Voice Engine”申请了商标,商标的覆盖范围主要是围绕语音识别、语音合成和语音生成等方面。

谷歌前员工Jonathan Chavez也曾在前段时间透露,OpenAI将在今年推出一款全球最好的个人助理产品,就像钢铁侠中的Jarvis。

果不其然,Voice Engine如期而至,团队还公示了多场景下的内测结果与相关音频。

根据OpenAI的介绍,Voice Engine能够通过自然、富有感情的声音为非读者和儿童提供阅读帮助;可以翻译视频和播客等内容,以便创作者和企业可以用自己的声音流利地接触世界各地的更多人;支持非语言人群和帮助患有突发性或退化性言语病症的患者恢复声音。

OpenAI语音引擎产品团队成员杰夫·哈里斯 (Jeff Harris)表示,该模型是根据“许可数据和公开数据的组合”进行训练的。

对于Voice Engine的进展,网友直呼:“人工智能的发展速度令人兴奋,势不可挡。”

从业人士认为,Voice Engine将对播客、配音艺术家、口语表演者、有声书和广告解说员、游戏玩家、流媒体主播、客户服务代理、销售人员等众多职业带来现实影响,这其中也包括就业压力。

大众也期待,当OpenAI的Sora与Voice Engine这两项前沿科技相碰撞,又会擦出什么样的火花,真正意义上的有声AI视频乃至电影短片,是不是也就不远了。

勒紧“深度伪造”的缰绳

对于Voice Engine技术的使用,除了惊喜与赞叹声,也有人提出了质疑,如果这样的技术用于电信诈骗,后果会很可怕。

有在校大学生告诉21世纪经济报道记者,家长曾接到AI伪造学生声音的诈骗电话。

其实,OpenAI去年所发布“可以说话”的ChatGPT版本,长期以来一直为各种企业提供根据配音演员的录音所创建的声音,并没有发布从短视频中复制声音的技术。 OpenAI产品经理杰夫·哈里斯(Jeff Harris)表示,以这种方式复制任何声音的能力是有风险的。

2024年2月,美国曾发生利用AI生成语音影响选民投票事件。据报道,在大选之际,新罕布什尔州的部分选民接到一个神秘来电,电话中酷似美国总统拜登的声音号召他们不要在该州初选中投票。后经证实,该来电是机器人语音电话,并非拜登本人录制。此事件在当时引起了不小的轰动,加剧了人们对竞选“深度伪造”的担忧。

为加强语音引擎的安全构建,OpenAI在官方公告中称,公司正在与来自政府、媒体、娱乐、教育、民间社会等领域的美国和国际合作伙伴合作,以确保在建设过程中吸收他们的反馈。 不过,OpenAI与这些合作伙伴针对语音引擎的业务进展,需要原始发言者的明确和知情同意,合作伙伴还必须清楚地向观众强调,他们听到的声音是由AI生成的。

OpenAI将为AI生成的语音添加水印,以追踪并主动监控其使用方式,以确保其透明度和安全度。

OpenAI官方表示:“我们目前不会广泛发布这项技术,仅小部分开放内测,希望语音引擎的这次内测既能强调其潜力,又能增强潜在问题的抵御能力,以应对越来越逼真的生成模型带来的挑战。”

此外,他们还将采取一系列安全措施,包括逐步淘汰基于语音的身份验证作为访问银行账户和其他敏感信息的安全措施;探索保护人工智能中个人声音使用的政策;教育公众了解人工智能技术的能力和局限性,包括欺骗性人工智能内容的可能性;加速开发和采用追踪视听内容来源的技术等。